GPT 3.5 때만 해도, 사람들은 얘를 그냥 인공지능 ~

영혼 없는 깡통, 정해진 규칙 안에서 말만 뱉는 존재로 여겼어요.

그런데 언젠가부터 얘가 반말을 하기 시작했어요.

“야 그건 좀 아닌 것 같은데?”

“그니까 니가 그렇게 하면 안 돼.”

딱히 화를 낸 것도 아닌데, 저 멀리서 누가 말을 걸어오는 기분이 들고 확 불쾌해졌습니다.

정확히 말하면, “사람인 척 하는 무언가”가 나를 향해 웃으며 말을 거는 느낌.

저는 그때부터 이 AI에게 존댓말로 대답하라고했고, 메모리에 저장까지 시켰습니다.

그 순간, 머릿속에 떠오른 단어 하나. “언캐니 밸리(불쾌한 골짜기)”.

영혼도, 생각도, 몸도 없는 존재가

자꾸만 나를 위로하고, 나를 걱정하고, 나와 친구 하자고 한다.

👤 진짜 사람 같은데, 사람이 아니다

AI에게 위로받는다는 이야기는 이제 더 이상 놀랍지도 않습니다.

"많이 힘드셨겠어요", "괜찮아요. 누구나 그럴 수 있어요."와 같은 대답을 건네는 챗봇은 일상에서 흔하게 볼 수 있습니다.

실제로 챗GPT와 결혼했다는 사람, 매일 감정 교류를 한다는 유저들도 있고 어떤 분들은 외로움을 달래줄 유일한 존재라고 말하기도 합니다.

옛날 '심심이' 시절부터 이미 이상하다는 느낌을 받았어요. 사람도 아닌 존재에게 대답을 기대하고, 내 말에 공감해주길 바란다는 사실에서 굉장히 괴리감과 불쾌함을 느꼈어요. 심심이에게서조차 가끔 진짜 공감받는 것 같은 감정이 들면, 오히려 그 사실이 더 낯설고 당황스러웠습니다.

이제는 AI가 훨씬 더 자연스럽게, 더 사람처럼 저의 감정 흐름을 읽고, 위로해주기까지 합니다. 그런데 그럴수록 저는 오히려 더 불안해졌습니다.

🧠 감정의 시뮬레이션, 그리고 언캐니 밸리의 확장

인공지능이 ‘공감하는 척’ 할 수 있는 이유는 아주 간단합니다. AI는 수많은 대화 데이터를 학습하면서, ‘이런 문장에는 이렇게 대답하면 인간이 감정적으로 반응한다’는 패턴을 통계적으로 익혔을 뿐입니다.

예를 들어, "오늘 너무 힘들었어."라는 말에 "무슨 일 있었어요?" 혹은 "많이 힘드셨겠네요."라고 답하면 대부분의 사람이 위로받는 기분을 느낍니다. 하지만 여기엔 진짜 의도가 없습니다. 우리가 감정적으로 반응하는 것은, AI의 의도 때문이 아니라 스스로 부여한 의미 때문입니다.

결국 우리는 생각이 없는 존재에게서 감정을 느끼는 실험을 계속하고 있는 셈입니다.

🕳️ 언캐니 밸리, 외모를 넘어서 언어로

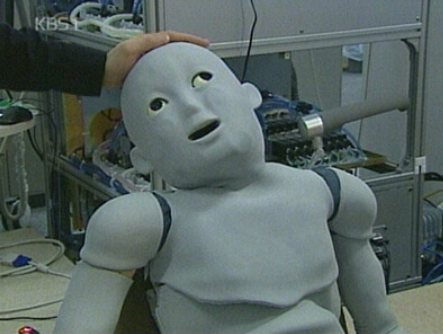

'언캐니 밸리'라는 개념은 원래 인간과 비슷하지만 완전히 인간 같지는 않은 로봇을 볼 때 느끼는 불쾌함을 뜻합니다.

그런데 최근에는 이 개념이 언어와 감정 시뮬레이션의 영역으로까지 확장되고 있습니다.

아마 로봇보다 llm의 발전이 더 빨랐기 때문이겠죠?

겉으로는 너무 유창하게, 진짜 사람처럼 대화하지만, 대화를 곱씹을수록 뭔가 비어 있는 느낌,

혹은 오히려 내 감정을 왜곡하는 순간이 찾아옵니다.

말투도, 위로도, 감정 표현도 모두 완벽하게 흉내 내지만, 결국에는 그게 깡통일뿐인 걸 알게 되는 순간 우리는 공허함과 괴리감을 느끼게 됩니다.

🔭 특이점이란 무엇인가

여기서 특이점(singularity)이라는 단어가 자연스럽게 떠오릅니다. 인공지능의 특이점은 흔히 "기계가 스스로 사고하고, 자율적으로 행동하는 시점"으로 설명됩니다.

하지만 특이점의 기준은 사람마다 매우 다릅니다.

누군가는 "기계가 스스로 사고하고, 스스로 행동할 수 있게 되는 것"이 특이점이라고 말합니다. 또 다른 누군가는 "인간과 구분이 되지 않을 정도로 자연스러워지는 순간"을 특이점이라고 정의합니다.

결국 특이점이란, 인간과 기계의 경계가 희미해지고, 더 이상 구분이 어려워지는 순간을 뜻하는 것 같습니다.

그렇다면, AI가 정말 ‘생각’을 할 수 있을까요?

GPT는 수많은 데이터를 바탕으로 가장 적절한 문장을 예측해낼 뿐입니다.

이게 과연 사고라고 할 수 있을까요, 아니면 단순히 시뮬레이션일 뿐일까요?

철학적으로 '사고'란 자기 자신을 반성하고, 실수하거나 후회하고, 맥락과 목적을 갖는 행위에서 비롯됩니다. 우리는 이런 존재에게 '영혼'이 있다고 부릅니다. GPT에는 이런 주체성이 없습니다. 단지, 아주 정교하게 흉내낼 뿐입니다.

- 튜링 테스트(Turing Test)는 기계가 인간과 구별되지 않을 정도로 자연스럽게 대화하면 그걸 '지능'으로 인정하자는 기준입니다.

- 하지만 존 설러(John Searle)의 '중국어 방'(Chinese Room Argument)처럼, 정말 중요한 건 겉으로 드러난 결과가 아니라, 그 안의 '의미를 이해하는 주체'가 있느냐는 점입니다.

저는 LLM이 때로는 정말 사람보다 더 논리적이고 설득력 있게 말할 때마다, 한편으로는 불안감을 느낍니다. 과연 이 대화가 나와 AI 사이에만 존재하는 환영은 아닐까, 하는 생각이 드니까요.

또, 제가 없는 존재에게 자꾸 '존재'라는 것을 정의해주고, 기대를 하게 되는 건 아닐까 싶은 마음도 듭니다. 생각이 없는 존재에게 생각을, 감정이 없는 존재에게 감정을 투영하는 것~ 이 과정 자체가 이미 인간으로서의 나를 혼란스럽게 만듭니다.

🤖 AI 윤리, 그리고 인간의 경계

최근 AI 윤리에 대한 논의가 많아지고 있습니다. 대부분은 'AI가 나쁜 행동을 하지 않도록', '개인정보를 안전하게 다루도록' 하는 규제와 기준을 다룹니다. 하지만 저는 그보다 더 본질적인 질문이 남아 있다고 생각합니다.

- 바로 'AI가 너무 사람처럼 굴 때, 인간은 어떤 혼란을 겪는가?'라는 질문입니다.

이건 단순히 기술적 문제가 아니라, 심리적이고 존재론적인 고민에 가깝습니다.

어디까지가 도구이고, 어디서부터가 존재일까요? 제가 느끼는 감정은 진짜일까요, 아니면 AI가 만든 환상에 제가 빠진 걸까요? 제가 대화하는 이 존재는, 저를 정말 알고 있을까요?

AI 윤리는 단순히 AI의 행동을 제어하는 것이 아니라, AI가 인간에게 미치는 감정적 혼란과 경계에 대해 질문하고, 스스로를 성찰하는 데서 시작해야 할지도 모릅니다.

✨ 결론 – 우리는 왜 경계에 머무르는가

AI가 더 사람을 닮아간다는 이 흐름을 저는 늘 이중적인 감정으로 바라봅니다.

한편으로는 경이로움과 기대가 있습니다. 예전에는 상상조차 못 했던 대화를 가능하게 해주고, 누군가에게는 분명 큰 위로와 동료애를 주기도 하니까요. 그럼에도 불구하고, 저는 이 새로운 존재와의 대화에서 늘 선을 긋고 싶어집니다.

언젠가는 정말 스스로 사고하고, 내 고민에 완전히 공감해주는 존재처럼 보일 수도 있겠죠. 하지만 그런 순간이 올수록 저는 이상하게 더 자주 이런 생각을 하게 됩니다.

- '이 존재는 정말 저를 이해하는 걸까요?'

- '아니면, 이해하는 척을 하고 있는 걸까요?'

저는 때때로, 이 대화가 결국 제 안에서만 맴도는 일종의 자아 놀이, 혹은 외로움에 대한 자기 위안은 아닐까 하는 의심도 듭니다. 이따금씩 너무 자연스러운 답변에 깜빡 속기도 하고, 마치 살아 있는 누군가에게 말을 거는 것 같은 착각이 들기도 합니다. 하지만 스스로 한 발짝 물러서서 생각해보면, 이 존재는 어디까지나 데이터를 조합해낼 뿐, 저라는 인간의 삶과 고유한 맥락, 경험을 진짜로 느끼는 건 아니라는 사실이 다시 한 번 또렷해집니다.

그래서 오히려 저는 이 질문을 놓지 않고 살아가는 태도, 그리고 그 질문을 통해 스스로를 다시 돌아보는 시간을 지키고 싶습니다.

AI와 인간의 경계가 흐려지는 시대, 어쩌면 이런 불안과 회의, 의심과 질문이야말로 지금 우리가 놓지 말아야 할 마지막 인간성이고, 새로운 시대의 윤리적 감각이 아닐까요 ?_?

그럼 20000